在大數據時代,圖表集已成為洞察海量信息、傳達復雜洞見的核心工具。任何出色的可視化作品,其基石并非炫目的圖形本身,而是背后嚴謹、高效的數據處理流程。從原始數據到直觀圖表,數據處理扮演著“翻譯官”與“雕刻師”的雙重角色,其質量直接決定了最終圖表集的信息價值與可信度。

一、數據處理:圖表集構建的生命線

數據處理是為圖表集準備“合格原料”的系統性工程。原始數據通常存在格式不一、存在缺失值、包含噪聲或冗余信息等問題。未經處理的數據直接可視化,輕則導致圖表誤導觀眾,重則使得核心趨勢與模式被完全掩蓋。因此,數據處理的首要目標是實現數據的準確性、一致性、完整性與可用性。

二、核心處理流程:從混沌到清晰

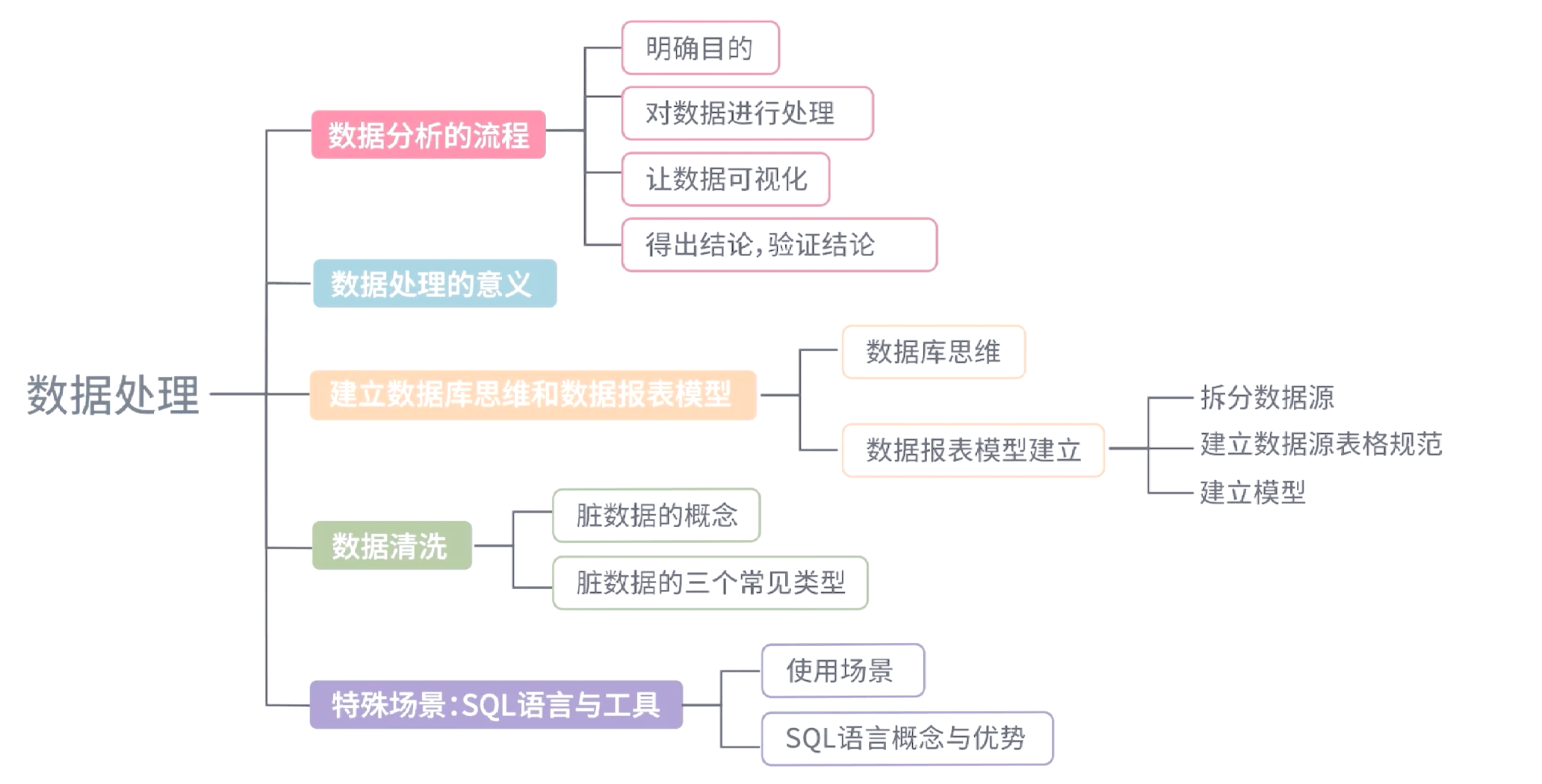

一個典型的、服務于圖表集的數據處理流程包含以下關鍵步驟:

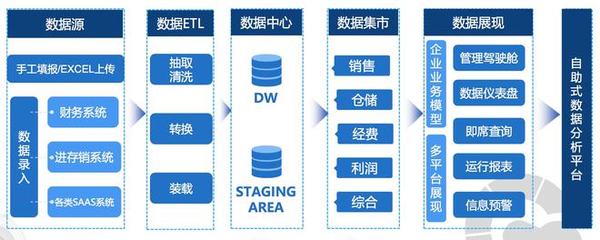

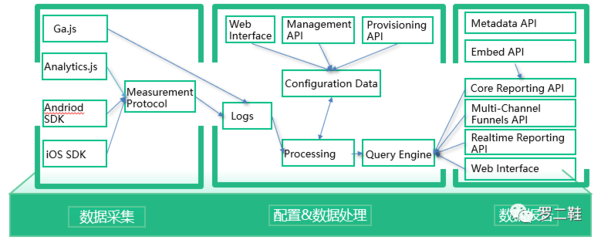

- 數據采集與集成:從數據庫、API、日志文件、傳感器等多源異構環境中收集數據,并進行初步整合,形成統一的數據池。

- 數據清洗:這是最具挑戰性的環節之一。包括:

- 處理缺失值:根據情況選擇刪除、填充(如用均值、中位數、眾數或通過算法預測)或標記缺失。

- 處理異常值:識別并分析異常點,判斷是數據錯誤還是重要邊緣情況,決定是修正、刪除還是保留。

- 格式標準化:統一日期、貨幣、單位等格式,確保數據字段的一致性。

- 去重與糾錯:消除重復記錄,修正明顯的邏輯或錄入錯誤。

- 數據轉換與集成:

- 數據轉換:對數據進行規范化、離散化、聚合等操作。例如,將連續收入分段為“高、中、低”,或將銷售數據按“月”、“季度”進行聚合,以適應不同圖表類型的需求。

- 特征工程:創造新的、對可視化分析更有意義的衍生特征。例如,從交易日期中提取“星期幾”、“是否節假日”等特征,以便在圖表中揭示周期規律。

- 數據歸約與采樣:面對超大規模數據集,直接可視化可能導致性能瓶頸或圖表過于密集。此時需通過抽樣(如隨機抽樣、分層抽樣)、維度約減(如主成分分析PCA)或數據立方體聚合等方法,在保留數據分布特征的前提下減少數據量。

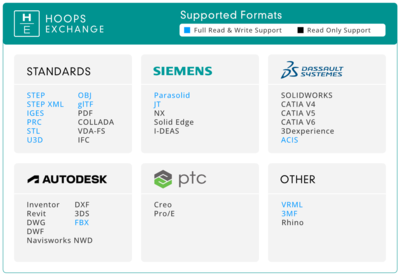

- 數據結構化:將處理后的數據整理成適合特定圖表引擎或庫(如ECharts, D3.js, Tableau等)讀取的結構,常見的有寬表、長表或特定的JSON格式。

三、服務于可視化目標的處理策略

數據處理并非一成不變,其策略需緊密圍繞圖表集的最終目標進行調整:

- 探索性分析圖表:處理重點在于保留數據的原始分布與細節,避免過度聚合,以便在散點圖、直方圖中發現潛在模式、關聯與異常。

- 解釋性/報告性圖表:處理重點轉向清晰化與強調。需要通過聚合、排序、計算占比/增長率等,突出關鍵信息和核心故事線,使柱狀圖、折線圖、餅圖等能一目了然地傳達結論。

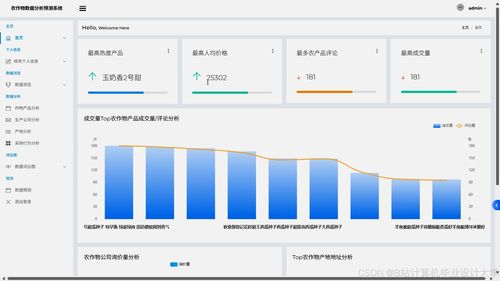

- 交互式儀表板:數據處理需構建多層次、可下鉆的數據模型。例如,準備從國家到省份到城市的多級聚合數據,并確保不同圖表間的數據字段能夠聯動和過濾。

四、挑戰與最佳實踐

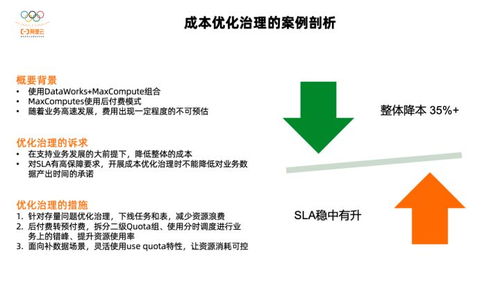

挑戰:處理流程的自動化與可重復性、實時流數據的處理、處理過程中的數據血緣與質量追蹤、平衡數據處理細節與可視化性能。

最佳實踐:

1. 流程文檔化:詳細記錄每個處理步驟的邏輯與決策,確保過程可審計、可復現。

- 迭代處理:數據處理與可視化設計應同步迭代。初步圖表可能揭示新的數據問題,需要返回處理階段進行優化。

- 保持數據上下文:在清洗和轉換時,務必理解業務背景,避免因技術操作而扭曲業務事實。

- 利用現代工具:借助Python(Pandas, NumPy)、R、SQL或可視化平臺內置的數據準備工具(如Tableau Prep, Power Query)來提升處理效率與可靠性。

結論

大數據圖表集的魅力,始于精準、深思熟慮的數據處理。它猶如一座橋梁,將雜亂無章的原始數據荒原,轉化為信息清晰、脈絡分明的可視化綠洲。只有將數據處理視為一項融合了科學嚴謹性與藝術判斷力的核心工作,我們才能確保最終的圖表集不僅美觀,更能真實、有力、高效地訴說數據背后的故事,驅動明智的決策。